Любители порнографии и фотопародий со знаменитостями объединились в отдельном уголке на сайте Reddit — в разделе «CelebFakes». В этой части сайта собираются те, кто просит и делает для всех желающих разные фотожабы, приставляя личики знаменитостей на кадры из фильмов для взрослых.

Этот раздел существует давно и так бы и оставался бы неприметным (что тут сложного, после примитивных знаний фотошопа Дональд Трамп может работать в секс шопе), если бы не неординарные навыки одного из пользователей. Он вывел на новый уровень понятие «вставить фото знаменитости в порно», приспособив для этого ... Нейросеть!

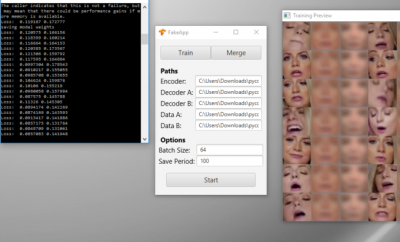

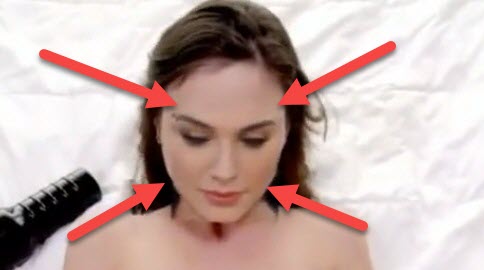

Творца роликов под ником Deepfakes прославили его видеоработы с Галь Гадот и Скарлетт Ийохансон. Он наложил их лица на лица актрис в сценах из порнофильмов и опубликовал в теме CelebFakes. Многие удивились детализации и качеству ролика: мимика Чудо-женщины менялась так, словно никакой обработки не было. Автор так же опубликовал в открытый доступ десктопную версию программы FakeApp, которая, по словам создателя, сможет поместить любую знаменитость в любой ролик.

Система «тренируется» при помощи роликов на YouTube и изображений в Google. В процессе обучения искусственный интеллект пытается сопоставить фрагменты исходных портретов с видеозаписью максимально правдоподобным образом. При создании провокационных роликов Deepfakes использует открытые алгоритмы машинного обучения и библиотеки TensorFlow и Keras. Специалист по искусственному интеллекту Алекс Шампанард отметил, что хорошая видеокарта справится с такой задачей за несколько часов, а вот бюджетному ПК придется провозиться несколько дней.

По словам Deepfakes, процесс создания подобных фейковых записей легче, чем кажется. Нейросеть сама отслеживает положение глаз, рта и граней лица актрисы на видео и подгоняет под него фотографии знаменитости. При правильных настройках на создание одного ролика у автора уходит всего несколько часов, и ему не нужно работать над каждым кадром видео — алгоритм обрабатывает сотни фото и видео «цели», создавая достоверный аналог её мимики. Но это работает далеко не с каждой записью.

"Рендеринг идёт со скоростью около 15 кадров в секунду, но наиболее ресурсоёмкая часть — это предварительная обработка. Я обычно собираю образцы лиц из исходного видео, прогоняю их через нейросеть (на это уходит несколько часов) и проверяю, какая часть видео достаточно хороша для полного преобразования".

Автор отмечает, что несмотря на заметный прогресс в сравнении со многими другими роликами-коллажами, его работы по замене лиц далеки от совершенства. Он может использовать только «удачные» фрагменты, не может создавать записи высокого качества, а контур лица знаменитости иногда находится в еле заметном расплывчатом квадратике, выделяющем его на фоне видео.

Пока знаменитости "использовавшиеся в эксперименте" активно не отреагировали на произошедшее. Все стандартно: с сайта Gfycat была удалена загруженная гифка с Галь Гадот, несмотря на то, что в ней не было постельной сцены. Также с разных ресурсов были удалены ролики, посвящённые Скарлетт Йоханссон, Обри Плаза и другим.

Если Голливудские знаменитости даже не комментировали старания реддитора, то по поводу подобных роликов активно высказались порноактрисы. По их словам, то, что кто-то создаёт подобные ролики без разрешения «снимающихся» в них актрис, неправильно.

К тому же подобные видеозаписи объективируют женщин, снявшихся в них, и не уважают их труд.

Нейросеть не в первый раз применяют в порноиндустрии. Летом умельцы с одного сайта запустили сервис, который с помощью нейросети находил порноактрис, похожих на фотографии любых обычных людей."Это действительно беспокоит. Это показывает, как некоторые мужчины типично видят в женщине объект, которым можно манипулировать и который можно заставить делать всё, чего они хотят… Это просто показывает совершенное неуважение к порноактрисам в фильме так же, как и к актрисам, — цитирует издание бывшую порноактрису Алиа Джанин".

Как бы ни было, достижения Deepfake в очередной раз намекают на возникновение вопросов безопасности использования опубликованных в интернете собственных фото. Некоторые негативные персонажи уже сейчас могут найти данные человека вплоть до его адреса по неаккуратно выложенным фото. Теперь к этому добавились и «доморощенные» ролики со вставкой лиц.

Использование технологии фейкового видео может снизить степень доверия аудитории к публикуемой в интернете информации в виде видеоконтента. Свободное распространение и совершенствование алгоритма deepfakes app может привести к тому, что обычный пользователь сети интернет в конце концов не сможет быстро отличить фальшивое видео от истинного.

Создатели фейкового видео в окончательном счёте перейдут от безобидных игр с порно версиями к формированию серьезных лживых новостей из политики, технологий и прочих.

ps

***

Лицо Адольфа Гитлера портировано на лицо аргентинского политика Маури́сио Ма́кри ;